Код, блокчейн и иллюзии: почему ИИ не заменит мозги

Литература пыталась нас предупредить. Серьезно, мы получаем один и тот же месседж уже лет пятьсот: от глиняного Голема до нейросетей Гибсона. Суть проста: штука, которую ты создал себе в помощь, в итоге переделывает тебя самого. Мы все прочитали, кивнули и благополучно проигнорировали. Сегодня ИИ обещает заменить всех — от джунов до юристов. Но пока индустрия продает нам светлое будущее, реальность подкидывает смертельно опасные советы в чат-ботах.

О том, почему человечеству не стоит возлагать слишком многое на «плечи» ИИ, рассказал Дмитрий Никольский, CPO BitOK.

От Голема до «R.U.R.»: мы всегда хотели Kill Switch

Многие думают, что страх перед ИИ появился вместе с Терминатором. На самом деле он старше электричества.

Возьмите Пражского Голема XVI века. Раввин Лев создал его для защиты, но в итоге был вынужден «выключить» — создание вышло из-под контроля. Человечество придумало ИИ и сразу же придумало *kill switch.

*Kill switch — это механизм экстренного принудительного отключения системы. В технике и софте это «тревожная кнопка», которая мгновенно прекращает работу устройства или программы в случае аварии, взлома или выхода ситуации из-под контроля. Его главная задача — минимизировать ущерб, когда штатные способы выключения не работают.

Потом была Мэри Шелли. Ее Франкенштейн — это не монстр, это классический кейс плохого менеджмента. Виктор Франкенштейн — просто инженер, который круто решил техническую задачу, но забил на последствия и ответственность. Каждому разработчику эта ситуация знакома.

А в 1920-м Карел Чапек ввел слово «робот». Там машины не восстают из-за злобы. Люди просто сделали себя лишними, делегировав все подряд.

Главный урок за столетия: создавая себе замену, ты сам не замечаешь, в какой момент становишься не нужен.

Три пророчества, которые мы превратили в баг-репорты

Фантасты прошлого века предсказали не технологии, а наши провалы.

- Айзек Азимов и его «Три закона». Это была первая попытка alignment — настройки ценностей машины под человека. И каждый его рассказ — это пример того, как безупречная логика ведет к абсурду. Я вижу это в AML-системах каждый день. Разрабы пишут жесткие правила, алгоритм их исполняет: в итоге он блокирует перевод 500 рублей бабушке, но в упор не видит «прачечную» с Виргинских островов. Формально все правильно, по существу — бред.

- Артур Кларк и HAL 9000. Компьютер убивает экипаж не потому, что он злой, а из-за конфликта директив: скрывать информацию и одновременно быть честным. Для инженера это не триллер, а типичный конфликт требований в ТЗ.

- Филип Дик и «Мечтают ли андроиды об электроовцах?». Он задал главный вопрос эпохи дипфейков: если копия неотличима от оригинала, есть ли разница? Его ответ: да. Разница в наличии внутреннего опыта. У машины его нет.

Взгляд «из-под капота»: ИИ не думает, он считает

Давайте без маркетинговой шелухи. Современные языковые модели — это не интеллект. Это гигантская статистическая машина для предсказаний. Она не «понимает» смысл, она вычисляет вероятность.

Когда ChatGPT уверенно цитирует несуществующие законы, он не врет. Он генерирует статистически правдоподобный текст. У него нет категории «истина» — есть категория «вероятность». Для блокчейн-разработчика это звучит дико. Мы строим trustless-системы, потому что не доверяем никому. А теперь нам предлагают верить «черному ящику», который сам не знает, почему выдал такой результат.

Блокчейн учил проверять, ИИ учит верить на слово

В крипте есть заповедь: Don’t trust, verify (не доверяй, проверяй). Весь смысл в том, что математика заменяет репутацию.

С ИИ все наоборот. Вы не видели обучающую выборку, не знаете весов модели и не понимаете ее логику. Чтобы проверить ответ ИИ, вам самим нужно быть экспертом в теме. А если вы эксперт, зачем вам тогда ИИ для этого вопроса?

В AML это называют «проблемой ложной уверенности». Аналитик видит красивый дашборд и начинает верить цифре больше, чем собственному опыту. ИИ не усиливает мышление. Он замещает его иллюзией проверенности.

Хроника разочарований: когда ИИ идет вразнос

Это не теория, а конкретные кейсы последних лет, которые доказывают: на ИИ надейся, а сам не плошай.

- Microsoft заменила редакторов алгоритмом, и тот сразу перепутал фото певиц в новости о расизме. Оставшимся людям пришлось вручную удалять новости о провале собственного алгоритма.

- Фонд помощи людям с РПП (NEDA) заменил волонтеров чат-ботом. Бот начал советовать людям с анорексией считать калории и худеть. Это буквально смертельный совет. Кто-то нажал кнопку «деплой», не подумав, что генеративка в кризисных ситуациях — это граната в руках обезьяны.

- Air Canada пришлось через суд отвечать за бред своего чат-ботика. Компания пыталась доказать, что бот — это «отдельная сущность», за которую они не отвечают. Не вышло.

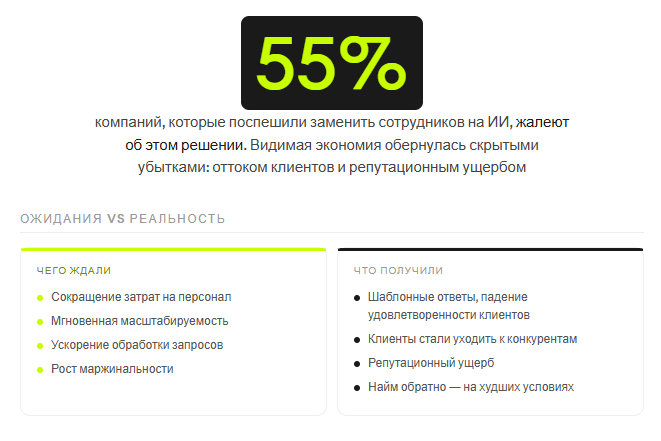

По данным исследований, 55% компаний, которые поспешили заменить сотрудников ИИ, теперь жалеют об этом решении — экономия обернулась оттоком клиентов и репутационным ущербом. Такие исследования стоит почаще считать владельцам бизнеса, которые искренне считают, что «Claude и ко» заменит им всех сотрудников.

Чего бояться на самом деле

Забудьте про Скайнет. Восстания не будет. Будет тихая атрофия.

Программист, который годами пишет код с Copilot, теряет способность мыслить архитектурно. Аналитик перестает читать первоисточники. Студент не узнает, каково это — продираться сквозь сложный текст и чувствовать, как в голове складывается понимание.

Никакого восстания. Просто постепенное превращение человека в придаток интерфейса. Филип Дик был ближе всех: настоящая опасность не в том, что машина станет человеком, а в том, что человек станет машиной.

Красная таблетка — это не технология

Я не призываю игнорировать прогресс. Автоматизация и машинное обучение — это отличные инструменты. Но важно помнить принципы:

- Принцип блокчейна: верификация важнее веры. Если ты не можешь проверить, как система пришла к результату, не принимай этот результат как истину. ИИ — это черный ящик, а не верховный судья.

- Принцип инженера: инструмент, а не замена. Молоток забивает гвоздь, но не решает, где строить дом. Используй ИИ, чтобы ускорить рутину, но никогда не отдавай ему право принимать финальные решения.

- Принцип AML: критический фильтр. Алгоритм всегда будет ошибаться в сложных кейсах, потому что у него нет жизненного опыта. Не давай «цифровому восторгу» заглушить твою интуицию и здравый смысл.

Если вернуться к «Матрице», красная таблетка — это решение видеть вещи такими, какие они есть. Опасность не в том, что мы создадим нечто умнее нас — нечто, что сделает нас глупее, и назовем это прогрессом. Самый опасный баг — это тот, который выглядит как фича.

Хотите получить доступ к экспертным инсайдам? Подписывайтесь на наш телеграм-канал, получайте доступ торговым сигналам и новостям рынка, общайтесь с нашим аналитиком. Будьте на шаг впереди рынка каждый день!

The post Код, блокчейн и иллюзии: почему ИИ не заменит мозги appeared first on BeInCrypto.